Festplattenlaufwerk

| Speichermedium

Festplattenlaufwerk

|

|

geöffnete Festplatte: drei Magnetscheiben, Schreib-/Lesekopf, Mechanik |

|

| Allgemeines | |

|---|---|

| Typ | magnetisch |

| Kapazität | bis 6 TByte (2013) |

| Ursprung | |

| Entwickler | IBM |

| Vorstellung | 1956 |

| Vorgänger | Magnetband |

Ein Festplattenlaufwerk (englisch hard disk drive = HDD), oft auch als Festplatte oder Hard Disk (abgekürzt HD) bezeichnet, ist ein magnetisches Speichermedium der Computertechnik, bei welchem Daten auf die Oberfläche im Platteninneren rotierender Scheiben geschrieben werden. Dazu wird die hartmagnetische Beschichtung der Plattenoberfläche entsprechend der aufzuzeichnenden Information magnetisiert. Durch die Remanenz erfolgt die Speicherung der Information. Das Auslesen der Information erfolgt durch Abtastung der Magnetisierung der Plattenoberfläche.

In Abgrenzung zu sequentiell adressierbaren Speichermedien wie Magnetband oder Lochstreifen werden Festplatten den direktadressierbaren Speichermedien (engl. direct access storage devices, DASD) zugerechnet, da kein linearer Durchlauf erforderlich ist, um zu einer bestimmten Speicherstelle zu gelangen.

Neuerdings werden mit vergleichbaren Speicherkapazitäten Flash-Speicher, sogenannte Solid-State-Drives (SSDs) und Hybridspeicher (Kombination aus SSD und Festplatte) angeboten, die über dieselben Schnittstellen (SATA usw.) angesprochen und vereinfacht als „Festplatten“ bezeichnet werden. Preislich liegen SSDs aktuell deutlich über HDDs.

Die Bezeichnung „Festplatte“ beschreibt zum einen, dass die Magnetplatte im Gegensatz zur „Wechselplatte“ fest mit dem Laufwerk beziehungsweise dem Computer verbunden ist. Zum anderen entspricht sie der englischen Bezeichnung „Hard Disk“, die im Gegensatz zu flexiblen (engl. floppy) Scheiben in Disketten aus starrem Material besteht.[1]

Allgemeine technische Daten

Festplatten werden durch Formatierung mit einer Zugriffsstruktur versehen. Seit Anfang der 1990er Jahre mit Aufkommen von IDE-Festplatten erfolgt dies beim Hersteller und kann auch nur noch durch den Hersteller durchgeführt werden. Der Begriff "Formatieren" für das Anlegen eines Dateisystems hat sich trotzdem erhalten, selbst für SSD-Speicher.

Speicherkapazität

Die Speicherkapazität einer Festplatte berechnet sich aus der Größe eines Sektors (512 Byte, 2048 Byte oder 4096 Byte) multipliziert mit der Anzahl der verfügbaren Sektoren. Die Größe der ersten Festplatten wurde in Megabyte angegeben, ab etwa 1997 in Gigabyte, seit etwa 2008 gibt es Platten im Terabyte-Bereich.

War die Art und Weise der Speicherung der Daten der ersten Platten noch von außen sichtbar (Sektoren pro Spur, Anzahl der Spuren, Anzahl der Köpfe, MFM- oder RLL-Modulation), so änderte sich dies mit Einführung der IDE-Platten Anfang der 1990er Jahre. Es war immer weniger zu sehen, wie die Daten intern gespeichert werden; das Ansprechen der Platte erfolgt über eine Schnittstelle, die Interna nach außen verbirgt.

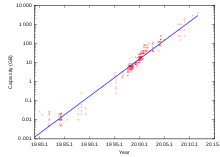

Die zeitliche Entwicklung der maximalen Festplattenkapazität zeigt einen annähernd exponentiellen Verlauf, vergleichbar mit der Entwicklung der Rechenleistung nach dem Mooreschen Gesetz. Die Kapazität hat sich bei leicht sinkenden Preisen etwa alle 16 Monate verdoppelt, wobei sich der Kapazitätszuwachs seit etwa 2005 verringerte (Januar 2007: 1 Terabyte[2], September 2011: 4 Terabyte).

Die Hersteller von Festplatten verwenden bei Speicherkapazitäten Präfixe in ihrer SI-konformen dezimalen Bedeutung. Eine Kapazitätsangabe von einem Terabyte bezeichnet hiernach eine Kapazität von 1012 Byte. Microsoft Windows und einige andere ältere Betriebssysteme verwenden historisch bedingt, aber entgegen einem 1996 verabschiedeten IEC-Standard bei der Kapazitätsangabe von Festplatten Präfixe in binärer Bedeutung, sodass ein "Terabyte" hier 240 Byte bezeichnet (die IEC-konforme Bezeichnung ist Tebibyte). Dies führt zu dem scheinbaren Widerspruch, dass bei einer Festplatte mit einer vom Hersteller angegebenen Kapazität von einem Terabyte das Betriebssystem als Kapazität 931 "Gigabyte" angibt. Unter den IEC-konformen Systemen OS X (ab 10.6) und Unix tritt dieser Effekt nicht auf.

Baugrößen

Die Abmessungen von Festplatten werden traditionell in Zoll angegeben. Dabei handelt es sich um keine exakten Größenangaben, sondern um einen Formfaktor. Übliche Formfaktoren für die Breite sind 5,25″, 3,5″, 2,5″ und 1,8″, für die Höhe z. B. 1″, ½″ und ⅜″. Die Zollangaben entsprechen meist in etwa dem Durchmesser der Platte, nicht der Breite des Laufwerkgehäuses. Teilweise werden jedoch kleinere Platten verwendet, um höhere Drehzahlen zu ermöglichen.[3]

Im Zuge der technischen Weiterentwicklung wurden immer wieder Baugrößen zugunsten kleinerer eingestellt, da diese neben dem geringeren Platzbedarf weniger anfällig gegen Erschütterungen sind und eine geringere Leistungsaufnahme aufweisen. Zwar bedeutet weniger Platz zunächst, dass ein Laufwerk kleinere Platten hat und damit weniger Speicherplatz zur Verfügung stellt. Die schnelle Technologieentwicklung in Richtung höherer Datendichten kompensiert diese Einschränkung jedoch erfahrungsgemäß kurzfristig.

Das erste Festplattenlaufwerk IBM 350 von 1956 hatte eine Baugröße von 24″. Mitte der 1970er kamen Modelle mit einer Größe von 8″ auf, die ebenfalls recht schnell durch die wesentlich handlicheren und vor allem leichteren 5,25″-Festplattenlaufwerke abgelöst wurden. Dazwischen gab es noch Größen von 14″ und 9″.

5,25″-Festplatten wurden 1980 von Seagate eingeführt; seit 1997 ist diese Gattung nicht mehr anzutreffen. Einige SCSI-Server-Laufwerke sowie das LowCost-ATA-Laufwerk BigFoot von Quantum waren die letzten Vertreter dieses Formats. Die Baugrößen dieser Laufwerke orientieren sich an denen von 5,25″-Diskettenlaufwerken: Die Breite dieser Laufwerke beträgt 5¾″ (146,05 mm), die Höhe bei Laufwerken mit voller Höhe (die zwei Steckplätze belegen) 3¼″ (82,55 mm), bei Laufwerken mit halber Höhe 1⅝″ (41,275 mm). Es gab Modelle mit noch geringerer Bauhöhe: die Modelle der BigFoot-Serie hatten eine Bauhöhe von ¾″ (19,05 mm) und 1″ (25,4 mm). Die Tiefe von 5,25″-Festplatten ist nicht festgelegt, sollte aber nicht wesentlich oberhalb von 200 mm liegen.

3,5″-Festplatten wurden 1987 (IBM PS/2 Model 50) eingeführt und sind derzeit (2012) Standard in Desktop-Computern. Die Baugrößen dieser Laufwerke orientieren sich an denen von 3,5″-Diskettenlaufwerken: Die Breite dieser Laufwerke beträgt 4″ (101,6 mm), die Höhe meist 1″ (25,4 mm). Seagate brachte mit der ST1181677 eine Festplatte mit 12 Scheiben und 1,6″ (40,64 mm) Höhe heraus [4]. Die Tiefe von 3,5″-Festplatten beträgt 5¾″ (146,05 mm).

2,5″-Festplatten wurden ursprünglich für Notebooks entwickelt, finden mittlerweile aber in Servern und Spezialgeräten (Multimedia-Playern, USB-Festplatten) Verwendung. Die Breite beträgt 70 mm, die Tiefe 100 mm. Die traditionelle Bauhöhe war ½″ (12,7 mm); mittlerweile gibt es Bauhöhen zwischen 5 mm und 15 mm, verbreitet sind 5 mm, 7 mm und 9,5 mm. Die erlaubte Bauhöhe hängt vom Gerät, in das die Festplatte eingebaut werden soll, ab. Der Interface-Anschluss ist gegenüber den größeren Bauformen modifiziert; bei ATA ist der Abstand der Pins von 2,54 mm auf 2 mm verringert. Es kommen weiterhin 4 Pins dazu (insgesamt 43 Pins), die den separaten Stromversorgungsstecker der größeren Modelle ersetzen. 2,5″-Festplatten benötigen nur eine Betriebsspannung in Höhe von 5 V; die bei größeren Platten notwendige zweite Betriebsspannung in Höhe von 12 V entfällt. 2,5"-SATA-Festplatten haben die gleichen Anschlüsse wie die 3,5"-Laufwerke, nur die 5 mm hohen Laufwerke haben wegen der geringen zur Verfügung stehenden Höhe teilweise einen speziellen SFF-8784-Anschluss.[5]

Seit 2006 bieten Seagate, Toshiba, Hitachi und Fujitsu 2,5″-Festplattenlaufwerke für den Einsatz in Servern an. Seit April 2008 wird von Western Digital mit der Velociraptor ein 2,5″-Festplattenlaufwerk (mit 15 mm Bauhöhe) mit 3,5″-Einbaurahmen als Desktop-Festplattenlaufwerk vermarktet.[6]

1,8″-Festplatten werden seit 2003 bei Subnotebooks, diversen Industrieanwendungen sowie in großen MP3-Playern verwendet. Die Breite beträgt 54 mm, die Tiefe zwischen 71 und 78,5 mm, die Höhe 8 mm. Es gibt Platten, die die Einbaubreite und -höhe von 2,5″-Festplatten haben (Hitachi Travelstar C4K40).

Noch kleinere Baugrößen mit 1,3″, 1″ und 0,85″ spielen kaum eine Rolle. Eine Ausnahme waren Microdrives in der Anfangszeit der digitalen Fotografie, sie ermöglichten mit einer Baugröße von 1″ vergleichsweise große und günstige Speicherkarten im CompactFlash-Typ-II-Format für Digitalkameras, wurden aber inzwischen durch Flash-Speicher verdrängt. 2005 gab es von Toshiba Festplattenlaufwerke mit einer Baugröße von 0,85″ und einer Kapazität von 4 GByte für Anwendungen wie MP3-Player.

Speicherkapazitäten der verschiedenen Baugrößen

| Jahr | 5,25″ | 3,5″ | 2,5″ | 1,8″ | 1,0″ | 0,85″ | andere Größe |

typ. Modell(e) mit hoher Kapazität | Quelle |

|---|---|---|---|---|---|---|---|---|---|

| 1956 | – | – | – | – | – | – | 5 MB (61 cm Durchmesser 1 t Masse) |

IBM 350 (1.200 min−1) | |

| 1962 | – | – | – | – | – | – | ≈ 25/28 MB | IBM Ramac 1301 (1.800 min−1) | [7] |

| 1981 | 10 MB | – | – | – | – | – | Seagate ST-412 (Aus dem IBM PC XT) | ||

| 1987 | 300 MB | – | – | – | – | – | Maxtor mit 300MB (5,25″) für 16800 DM (PC/AT) bzw. 17260 DM (PC/XT), Januar 1987 | ||

| 1988 | 360 MB | 20 MB | – | – | – | – | Maxtor XT-4380E (5,25″) bzw. Fuji FK309-26 | ||

| 1990 | 676 MB | 106 MB | – | – | – | – | Maxtor XT-8760E (5,25″) bzw. Conner CP3104 | ||

| 1992 | 2 GB | 426 MB | 120 MB | – | – | – | 20 MB (1,3") | Digital (DEC) DSP-5200S ('RZ73', 5,25″), Seagate ST1480A (3,5″) bzw. Conner CP2124 (2,5″), Hewlett-Packard HP3013 "Kittyhawk" (1,3") | [8] |

| 1993 | – | 1,06 GB | – | – | – | – | Digital RZ26 (3,5″) | ||

| 1994 | – | 2,1 GB | – | – | – | – | Digital RZ28 (3,5″) | ||

| 1995 | 9,1 GB | 1,6 GB | 422 MB | – | – | – | Seagate ST410800N (5,25″ FH), Conner CFS1621A (3,5″) bzw. Conner CFL420A (2,5″) | ||

| 1997 | 12 GB | 16,8 GB | 4,8 GB | – | – | – | Quantum Bigfoot (12 GB, 5,25″), Nov. 1997, IBM Deskstar 16GP (3,5″) bzw. Fujitsu MHH2048AT (2,5″) | [9] | |

| 1998 | 47 GB | – | – | – | – | – | Seagate ST446452W (47 GB, 5,25″), 1.Quartal 1998 | [10] | |

| 2001 | * | 180 GB | 40 GB | – | 340 MB | – | Seagate Barracuda 180 (ST1181677LW) | ||

| 2002 | * | 320 GB | 60 GB | – | – | – | Maxtor MaXLine-Plus-II (320 GB, 3,5″), Ende 2002; IBM IC25T060 AT-CS | [11] | |

| 2005 | * | 500 GB | 120 GB | 60 GB | 8 GB | 6 GB | Hitachi Deskstar 7K500 (500 GB, 3,5″), Juli 2005 | [12] | |

| 2006 | * | 750 GB** |

200 GB | 80 GB | 8 GB | * | Western Digital WD7500KS, Seagate Barracuda 7200.10 750 GB, u. a. | [13] | |

| 2007 | * | 1 TB** |

320 GB** |

160 GB | 8 GB | * | Hitachi Deskstar 7K1000 (1000 GB, 3,5″), Januar 2007 | [14] | |

| 2008 | * | 1,5 TB** |

500 GB** |

250 GB** |

* | * | Seagate ST31500341AS (1500 GB, 3,5″), Juli 2008 Samsung Spinpoint M6 HM500LI (500 GB, 2,5″), Juni 2008 Toshiba MK2529GSG (250 GB, 1,8″), September 2008 LaCie LF (40 GB, 1,3″), Dezember 2008 |

[15] [16] [17] [18] |

|

| 2009 | * | 2 TB** |

1 TB** |

250 GB** |

* | * | Western Digital Caviar Green WD20EADS (2000 GB, 3,5″), Januar 2009, Seagate Barracuda LP ST32000542AS (2 TB, 3,5″, 5.900 min−1) Western Digital Scorpio Blue WD10TEVT (1000 GB, 2,5″, Bauhöhe 12,5 mm), Juli 2009 sowie WD Caviar Black WD2001FASS und RE4 (beide 2 TB, September 2009) Hitachi Deskstar 7K2000 (2000 GB, 3,5″), August 2009 |

[19] |

|

| 2010 | * | 3 TB** |

1,5 TB** |

320 GB** |

* | * | Hitachi Deskstar 7K3000 & Western Digital Caviar Green (3,5″) Seagate FreeAgent GoFlex Desk (2,5″), Juni 2010 Toshiba MK3233GSG (1,8″) |

[22] |

|

| 2011 | * | 4 TB** |

1,5 TB** |

320 GB** |

* | * | Seagate FreeAgent® GoFlex™ Desk (4 TB, 3,5″), September 2011 | [23] |

|

| 2012 | * | 4 TB** |

2 TB** |

320 GB** |

* | * | Western Digital Scorpio Green 2000 GB, SATA II (WD20NPVT), August 2012 | [24] |

|

| 2013 | * | 6 TB** |

2 TB** |

320 GB** |

* | * | HGST Travelstar 5K1500 1.5 TB, SATA 6 Gb/s, 9,5 mm, 2,5 Zoll (0J28001), August 2013 Samsung Spinpoint M9T, 2TB, SATA 6 Gb/s, 9,5 mm, 2,5 Zoll, November 2013 Hitachi Ultrastar He6, 6TB, 3.5", 7 Platter mit Heliumfüllung, November 2013 |

[25] [26] [27] |

Anmerkungen:

- Die Kapazitätsangaben beziehen sich immer auf das im jeweiligen Jahr größte käuflich erhältliche Festplattenlaufwerk, unabhängig von seiner Drehzahl oder Schnittstelle.

- Die Festplattenhersteller verwenden im Gegensatz zu den Herstellern mancher Betriebssysteme IEC-gerecht für Festplattenkapazitäten die SI-Präfixe, d. h. 1 MB = 106 Byte, 1 GB = 109 Byte, 1 TB = 1012 Byte.

- *: Baugröße veraltet; nicht mehr in Gebrauch

- **: unter Verwendung von Perpendicular Recording

Sollen größere Datenmengen oder große Datenmengen statt auf einer einzelnen großen, teuren Platte auf günstigeren, kleinen und langzeiterprobten Platten gespeichert werden, kann man sie mit einem Logical Volume Manager als JBOD zusammenfassen oder mit RAIDs zusätzlich gegen Ausfälle vorbeugen und sie in Disk-Arrays zusammenfassen. Dies kann in einem Server oder einem Network Attached Storage geschehen, welcher von mehreren genutzt werden kann, oder man baut überhaupt ein eigenes Storage Area Network auf. Man kann auch (meist externes) Cloud-Computing nutzen, welches die bisher angesprochenen Techniken nutzt.

Aufbau und Funktion

Physischer Aufbau der Einheit

Eine Festplatte besteht aus folgenden Baugruppen:

- einer oder mehreren rotierbar gelagerten Scheiben (engl.: Platter, plural: Platters),

- einer Achse, auch Spindel genannt, auf der die Scheiben übereinander montiert sind,

- einem Elektromotor als Antrieb für die Scheibe(n),

- beweglichen Schreib-/Leseköpfen (Heads),

- jeweils einem Lager für Platter (meistens hydrodynamische Gleitlager) sowie für die Schreib-/Leseköpfe (auch Magnetlager),

- einem Antrieb für die Schreib-/Leseköpfe (engl.: Actuator, deutsch: Aktor),

- der Steuerelektronik für Motor- und Kopfsteuerung,

- einem DSP für Verwaltung, Bedienung des Interfaces, Steuerung der Schreib/Leseköpfe. Modulation und Demodulation der Signale der Schreiblese-Köpfe erfolgt dabei durch integrierte Spezialhardware und wird nicht direkt vom DSP durchgeführt. Die benötigte Verarbeitungsleistung der Demodulation liegt im Bereich ~107 MIPS.

- DDR-RAM für Betriebssystem, Programm, temporäre Daten und Festplattencache. Üblich sind derzeit 2 bis 64 MiB.

- der Schnittstelle zum Ansprechen der Festplatte von außen und

- einem stabilen Gehäuse (siehe eigenes Kapitel unten).

Technischer Aufbau und Material der Datenscheiben

Die Scheiben bestehen häufig aus oberflächenbehandelten Aluminium-Legierungen. Bei Scheiben mit hoher Datendichte wird aber vorrangig auf Magnesium-Legierungen, Glas oder Glasverbundstoffe zurückgegriffen, da diese Materialien weniger Diffusion aufweisen.[28][29] Sie müssen möglichst formstabil (sowohl unter mechanischer als auch thermischer Belastung) sein und eine geringe elektrische Leitfähigkeit aufweisen, um die Größe der Wirbelströme gering zu halten. Da die magnetisierbare Schicht besonders dünn sein soll, darf das Material der Scheiben selbst jedoch keine magnetischen Eigenschaften besitzen und dient nur als Träger der Magnetschicht.

Auf die Scheiben wird eine Eisenoxid- oder Kobaltschicht von ungefähr einem Mikrometer Stärke aufgetragen. Heutige Festplatten werden durch Sputtern von sogenannten „high storage density media“ (dt. svw. Materialien für hohe Speicherdichte) wie CoCrPt hergestellt.[30] Die magnetische Schicht wird zusätzlich mit einer Deckschicht aus diamantähnlichem Kohlenstoff versehen (engl. „carbon overcoat“), um mechanische Beschädigungen zu vermeiden. Die zukünftige Verkleinerung der magnetischen `Bits´ erfordert sowohl die Erforschung von „ultra high storage density media“ als auch von alternativen Konzepten, da man sich langsam dem superparamagnetischen Limit nähert. Zusätzlich wurde eine Steigerung der Datendichte durch besseres Trägermaterial sowie durch die Optimierung der Schreibverfahren erreicht.

In Desktop-Festplatten der Jahre 2000 bis 2002 von IBM (Deskstar 75GXP/40GV DTLA-30xxxx, Deskstar 60GXP/120GXP IC35Lxxxx) kam Glas als Material für die Scheiben zum Einsatz. Neuere Modelle der Festplattensparte von IBM (2003 übernommen durch Hitachi) verwenden jedoch mit Ausnahme von Server-Festplatten wieder Aluminium. In dem Festplattengehäuse befinden sich eine oder mehrere übereinander liegende, rotierende Scheiben. Gebaut wurden bisher Festplatten mit bis zu zwölf Scheiben, üblich sind derzeit ein bis vier. Energieverbrauch und Geräuschentwicklung innerhalb einer Festplattenfamilie steigen mit der Scheibenanzahl. Üblich ist es, alle Oberflächen der Platten zu nutzen (n Platten, 2n Schreibleseköpfe). Einige Plattengrößen (z. B. 320-GB-Platten bei 250 GB/Scheibe) kommen mit einer ungeraden Anzahl von Schreib-/Leseköpfen (hier: 3) aus und benutzen eine Oberfläche nicht.

Mit Ablösung des Longitudinal Magnetic Recording durch Perpendicular Magnetic Recording (PMR), einem seit den 1970er-Jahren bekannten, aber damals nicht beherrschten Speicherprinzip, gelang es durch intensive Forschung seit 2000, die Datendichte weiter zu steigern. Die erste Festplatte mit dieser Speichertechnik kam 2005 von Hitachi: eine 1,8″-Festplatte mit 60 GByte. Alle seit 2008 entwickelten Festplatten enthalten diese Technologie (ab 200 GB/Scheibe bei 3,5″).

Achsen-Lagerung und Drehzahlen

In Arbeitsplatzrechnern oder Privat-PCs verwendete Festplatten – momentan zum größten Teil Platten mit ATA-, SATA-, SCSI oder SAS-Schnittstelle – rotieren mit Geschwindigkeiten von 5.400 bis 10.000 min−1. Im Bereich der Hochleistungsrechner und Server werden überwiegend Festplatten eingesetzt, die 10.000 oder 15.000 min−1 erreichen. Bei den 2,5-Zoll-Festplatten für mobile Geräte liegen die Spindelgeschwindigkeiten im Bereich von 5.400 bis 7.200 min−1, wobei 5.400 min−1 sehr verbreitet ist.

Die Achsen der Scheiben früherer Festplatten (bis 2000) waren kugelgelagert; in neuerer Zeit werden überwiegend hydrodynamische Gleitlager (engl. „fluid dynamic bearing“ – FDB) verwendet. Diese zeichnen sich durch eine höhere Lebensdauer, geringere Geräuschentwicklung und geringere Herstellungskosten aus.

Die Schreib-Lesekopfeinheit

Der Schreib-/Lesekopf (Magnetkopf) des Schreibfingers, im Prinzip ein winziger Elektromagnet, magnetisiert winzige Bereiche der Scheibenoberfläche unterschiedlich und schreibt somit die Daten auf die Festplatte. Aufgrund eines Luftpolsters, das durch die Reibung der Luft an der rotierenden Scheibenoberfläche erzeugt wird, schweben die Schreib-/Leseköpfe (vgl. Bodeneffekt). Die Schwebehöhe lag 2000 im Bereich von etwa 20 nm. Aufgrund dieser geringen Distanz darf die Luft innerhalb des Festplattengehäuses keinerlei Verunreinigungen enthalten. Bei neueren Festplatten mit Perpendicular-Recording-Technik schrumpft dieser Abstand auf 5 bis 6 nm. Aktuell angekündigte Platten (2011) mit 1 TByte/Scheibe erlauben noch Flughöhen von maximal 3 nm, damit das Signal durch Abstandsverluste nicht zu stark geschwächt wird. Die Herstellung von Festplatten erfolgt deshalb wie die von Halbleitern in Reinräumen. Der Bodeneffekt ist in diesem Zusammenhang sehr nützlich zur Einhaltung der richtigen Flughöhe des Schreib-/Lesekopfes über der rotierenden Scheibe.

Die Daten wurden bis circa 1994 durch die Induktionswirkung des Magnetfeldes der magnetisierten Fläche der Datenträgeroberfläche in der Spule des Schreib-/Lesekopfes ausgelesen. Über die Jahre wurden jedoch aufgrund der steigenden Datendichte die Flächen, auf denen einzelne Bits gespeichert werden, immer kleiner. Um diese Daten auszulesen, wurden kleinere und empfindlichere Leseköpfe benötigt. Diese wurden nach 1994 entwickelt: MR-Leseköpfe sowie einige Jahre später GMR-Leseköpfe (Riesenmagnetowiderstand). Der GMR-Lesekopf ist eine Anwendung der Spintronik.

In der Anfangszeit der Festplatten wurden die Schreib-/Leseköpfe mit Schrittmotoren angesteuert, da die Spurabstände noch groß waren (siehe auch bei Aktor). Bei den derzeit üblichen Schreibdichten sorgen Tauchspulsysteme mit Lageregelung für die Positionierung. Bei der Hitachi Deskstar 7K500 beträgt die Spurdichte 5,3 Spuren/µm, die Bitdichte 34,3 Bit/µm. Das sind 182 Bit/µm².

Zum Schutz der Scheiben-Oberflächen vor dem Aufsetzen der Schreib-/Leseköpfe (dem sogenannten Head-Crash) fahren diese, noch bevor sich beim Ausschalten der Festplatte die Umdrehungsgeschwindigkeit merklich verringert hat, in die Landezone (engl. „landing zone“), in der sie fixiert werden. Beim plötzlichen Wegfall der Versorgungsspannung wird der Antrieb als Generator geschaltet und mit der so gewonnenen Energie ein Schwenkimpuls für den Kopfarm erzeugt. Dieses Parken erhöht die Stoßfestigkeit der Festplatten für einen Transport oder Umbau. Die Parkposition kann sich außerhalb der Scheiben oder im Innenbereich der Platten befinden. Dabei setzt der Schreib-/Lesekopf auf einem vordefinierten Bereich der Festplatte auf, der keine Daten enthält. Die Oberfläche dieses Bereichs ist besonders vorbehandelt, um ein Festkleben des Kopfes zu vermeiden, und so einen späteren Wiederanlauf der Festplatte zu ermöglichen. Die Fixierung geschieht z. B. über einen Magneten, der den Lesekopf festhält.

Bei älteren Festplatten wurden die Schreib-/Leseköpfe bei fast allen Modellen aus dem Plattenstapel herausgefahren. Später (1990er, 2000er) wurde zunehmend eine Parkposition im Innenbereich bevorzugt. 2008 kommen beide Varianten vor. Bei Notebook-Platten bietet die Parkposition außerhalb des Plattenstapels zusätzlichen Schutz vor Beschädigung der Oberflächen der Scheiben bei Transport (Erschütterung) der Festplatte.

Bei älteren Festplatten mussten die Köpfe vor dem Ausschalten explizit per Befehl vom Betriebssystem geparkt werden – Schrittmotoren benötigten viele koordinierte Impulse zum Parken, die sich nach Wegfall der Versorgungsspannung nur sehr schwer oder gar nicht generieren ließen. Auch die Köpfe moderner Festplatten können explizit geparkt werden, da der beschriebene automatische Parkmechanismus nach Wegfall der Versorgungsspannung zu einem erhöhten Verschleiß führen kann.[31] Der Parkbefehl wird heute automatisch beim Herunterfahren des Systems vom Gerätetreiber abgesetzt.

Bei modernen Laptops sorgt ein Beschleunigungssensor für das Parken des Festplattenfingers noch während eines eventuellen freien Falls, um so den Schaden beim Sturz eines Rechners zu begrenzen.

Festplatten-Gehäuse

Das Gehäuse einer Festplatte ist sehr massiv. Meist ist es ein aus einer Aluminiumlegierung bestehendes Gussteil, und mit einem Edelstahl-Blechdeckel versehen.

Es ist staub-, aber nicht luftdicht abgeschlossen: Durch eine mit einem Filter versehene, kleine Öffnung kann bei Temperaturänderungen oder anders verursachten Luftdruckschwankungen Luft ein- oder austreten, um so die Druckunterschiede auszugleichen. Diese Öffnung – siehe nebenstehende Abbildung – darf nicht verschlossen werden. Da der Luftdruck im Gehäuse mit zunehmender Höhe über dem Meeresspiegel abnimmt, zum Betrieb aber ein Mindestdruck erforderlich ist, dürfen diese Festplatten nur bis zu einer bestimmten, maximalen Höhe betrieben werden. Diese ist in der Regel im zugehörigen Datenblatt vermerkt. Die Luft ist erforderlich, um die direkte Berührung von Schreib-/Lesekopf und Datenträgeroberfläche zu verhindern, siehe oben.

Bei neueren Laufwerken wird der Filter durch eine elastische Membran ersetzt, die das System durch Aufwölben in die eine oder andere Richtung an wechselnde Druckverhältnisse anpassen kann.

Wird eine Festplatte in normaler, verunreinigter Luft geöffnet, sorgen bereits kleinste Staub-/Rauchpartikel, Fingerabdrücke usw. für meist irreparable Beschädigungen der Plattenoberflächen und der Schreib-/Leseköpfe.

Einbau

Bis etwa in die 1990er Jahre war für Festplatten eine definierte Einbaulage erforderlich und in der Regel nur waagerechter Betrieb (aber nicht "über Kopf") oder aber senkrechte Lage ("auf der Kante") erlaubt. Dies ist für heutige Laufwerke nicht mehr erforderlich und nicht mehr spezifiziert; sie können in jeder Lage betrieben werden. Alle Festplatten sind im Betrieb gegen Vibration empfindlich, da dadurch die Positionierung der Köpfe gestört werden kann. Wird eine Festplatte elastisch gelagert, ist dieser Punkt besonders zu berücksichtigen.

Speichern und Lesen von Bits

Die Scheibe mit der Magnetschicht, in der die Information gespeichert ist, rotiert an den Schreib-/Leseköpfen (s. o.) vorbei. Beim Lesen verursachen dabei Änderungen in der Magnetisierung der Oberfläche durch elektromagnetische Induktion einen Spannungsimpuls im Lesekopf. Bis zum Anfang des 21. Jahrhunderts wurde dabei fast ausschließlich die longitudinale Aufzeichnung verwendet, erst dann wurde auch die senkrechte Aufzeichnung eingeführt, die wesentlich höhere Schreibdichten erlaubt, aber kleinere Signale beim Lesen bewirkt, wodurch sie schwieriger zu beherrschen ist. Beim Schreiben dient derselbe Kopf zum Einschreiben der Information in die Magnetschicht. Zum Lesen sollte ein Magnetkopf anders ausgelegt sein als zum Schreiben, beispielsweise was die Breite des Magnetspalts betrifft; wird er für beides verwendet, müssen Kompromisse eingegangen werden, die die Leistung wieder begrenzen. Es gibt dazu neuere Ansätze durch spezielle Geometrien und Spulenwicklungen, diese Kompromisse effizienter zu gestalten.

Ein Leseimpuls entsteht also nur bei einer Änderung der Magnetisierung. (Mathematisch: Der Lesekopf „sieht“ sozusagen nur die Ableitung der Magnetisierung nach der Ortskoordinate.) Diese Impulse bilden einen seriellen Datenstrom, der wie bei einer seriellen Schnittstelle von der Leseelektronik ausgewertet wird. Wenn nun beispielsweise Daten vorliegen, die zufällig über lange Strecken nur den logischen Pegel "0" aufweisen, tritt solange keinerlei Änderung auf, also auch kein Signal am Lesekopf. Dann kann die Leseelektronik aus dem Takt kommen und falsche Werte lesen. Zur Abhilfe werden verschiedene Verfahren eingesetzt, die zusätzliche, umgekehrt gepolte Bits in den Datenstrom einfügen, um eine zu lange Strecke einheitlicher Magnetisierung zu vermeiden. Beispiele dieser Verfahren sind MFM und RLL, die allgemeine Technik wird unter Leitungscode erläutert.

Der Schreibvorgang ist dagegen vergleichsweise einfach und direkt: Je nach Logikpegel des Bits wird ein Strom gleichen Betrags, aber unterschiedlicher Polung in die Magnetspule des Schreibkopfs gespeist. Der Strom bewirkt ein Magnetfeld, das Feld wird vom Magnetkern des Kopfs gebündelt und geführt. Im Spalt des Schreibkopfs treten die Magnetfeldlinien dann in die Oberfläche der Festplatte über und magnetisieren sie dabei in die gewünschte Richtung.

Speichern und Lesen von Byte-organisierten Daten

Magnetische Festplatten organisieren ihre Daten – im Gegensatz zu Direktzugriffsspeichern (der sie in Bytes oder in kleinen Gruppen von 2 bis 8 Byte anordnet) – in Datenblöcken (wie z. B. 512, 2048 oder 4096 Byte), weshalb dieses Verfahren blockbasierte Adressierung genannt wird. Dabei können seitens der Hardware immer nur ganze Datenblöcke oder Sektoren gelesen und geschrieben werden.

Das Lesen von Blöcken erfolgt durch Angabe der linearen Sektornummer. Die Festplatte „weiß“, wo sich dieser Block befindet, und liest beziehungsweise schreibt ihn auf Anforderung.

Beim Schreiben von Blöcken:

- werden diese zuerst mit Fehlerkorrekturinformationen versehen,

- werden sie einer Modulation unterzogen: früher waren GCR, MFM, RLL üblich, heutzutage haben PRML und neuerdings EPRML diese abgelöst, dann

- wird der Schreib-/Lesekopf-Träger in die Nähe der Spur gefahren, die beschrieben werden soll,

- liest der Schreib-/Lesekopf, welcher der informationtragenden Oberfläche zugeordnet ist, das Spursignal und führt die Feinpositionierung durch. Dazu gehört zum einen, die richtige Spur zu finden, zum anderen diese Spur auch genau mittig zu treffen.

- Ist der Schreiblesekopf stabil auf der Spur und befindet sich der richtige Sektor unter dem Schreiblesekopf, wird die Blockmodulation geschrieben.

- Bei vermuteter Fehlposition ist der Schreibvorgang sofort abzubrechen, damit keine Nachbarspuren (teilweise irreparabel) zerstört werden.

Beim Lesen werden diese Schritte umgekehrt ausgeführt:

- Schreib-/Lesekopf-Träger in die Nähe der Spur fahren, die gelesen werden soll.

- der Schreib-/Lesekopf, welcher der informationstragenden Oberfläche zugeordnet ist, liest das Spursignal und führt die Feinpositionierung durch.

- Nun wird die Spur so lange (oder etwas länger) gelesen, bis der gewünschte Sektor erfolgreich gefunden wurde.

- Bei diesem Vorgang gefundene Sektoren werden zuerst demoduliert, dann einer Vorwärts-Fehlerkorrektur unterzogen.

- Üblicherweise werden meist weitaus mehr Sektoren als der angeforderte Sektor gelesen. Diese landen normalerweise im Festplattencache (wenn nicht schon vorhanden), da die Wahrscheinlichkeit groß ist, dass sie in Kürze noch benötigt werden.

- War ein Sektor schlecht lesbar (mehrere Leseversuche notwendig, Fehlerkorrektur zeigte etliche korrigierbare Fehler auf), wird er üblicherweise remappt, d. h. an einer anderen Stelle gespeichert.

- War der Sektor nicht mehr lesbar, wird ein sogenannter CRC-Fehler gemeldet.

Physischer Aufbau der Scheiben

(A) Spur (auch Zylinder), (B) Sektor, (C) Block, (D) Cluster

Die Magnetisierung der Beschichtung der Scheiben ist der eigentliche Informationsträger. Sie wird vom Schreib-/Lesekopf auf kreisförmigen, konzentrischen Spuren erzeugt, während die Scheibe rotiert. Eine Scheibe enthält typischerweise einige tausend solcher Spuren, meist auf beiden Seiten. Die Gesamtheit aller gleichen, d. h. übereinander befindlichen Spuren der einzelnen Platten(oberflächen) nennt man Zylinder. Jede Spur ist in kleine logische Einheiten unterteilt, die man Blöcke nennt. Ein Block enthält traditionell 512 Byte an Nutzdaten. Jeder Block verfügt dabei über Kontrollinformationen (Prüfsummen), über die sichergestellt wird, dass die Information korrekt geschrieben oder gelesen wurde. Die Gesamtheit aller Blöcke, die die gleichen Winkelkoordinaten auf den Platten haben, nennt man Sektor. Der Aufbau eines speziellen Festplattentyps, d. h. die Anzahl der Spuren, Oberflächen und Sektoren, wird als Festplattengeometrie bezeichnet. Der Begriff Sektor wird jedoch fälschlicherweise häufig synonym für Block verwendet.

Da - als die Nummerierung der Blöcke bei steigenden Festplattenkapazitäten die Wortgrenze (16 Bit) überstieg - manche Betriebssysteme zu früh an Grenzen stießen, führte man Cluster ein. Das sind Gruppen von jeweils einer festen Anzahl an Blöcken (z. B. 32), die sinnvollerweise physisch benachbart sind. Das Betriebssystem spricht dann nicht mehr einzelne Blöcke an, sondern verwendet auf seiner (höheren) Ebene als kleinste Zuordnungseinheit diese Cluster. Erst auf Hardwaretreiber-Ebene wird dieser Zusammenhang aufgelöst.

Bei modernen Festplatten ist normalerweise die wahre Geometrie, also die Anzahl an Sektoren, Köpfen und Zylindern, die vom Festplatten-Controller verwaltet werden, nach außen (d. h. für den Computer bzw. den Festplattentreiber) nicht sichtbar. Der Computer, der die Festplatte benutzt, arbeitet dann mit einer virtuellen Festplatte, die völlig andere Geometriedaten aufweist. Das erklärt, warum zum Beispiel eine Festplatte, die real nur vier Köpfe aufweist, vom Computer mit 255 Köpfen gesehen wird. Der Grund für dieses virtuelle Konzept ist, dass man Begrenzungen PC-kompatibler Hardware überwinden wollte. Heute übliche Festplatten teilen weiterhin die Platten in Zonen auf, wobei die Zahl der Blöcke pro Spur innerhalb einer Zone gleich ist, beim Wechsel der Zone von innen nach außen aber zunimmt. Die innerste Zone hat die wenigsten Blöcke pro Spur, die äußerste Zone die meisten, weshalb die kontinuierliche Übertragungsrate beim Zonenwechsel von außen nach innen abnimmt.

Der Festplatten-Controller kann defekte Blöcke in die sogenannte hot-fix-area ausblenden, um dann einen Block aus einem Reserve-Bereich einzublenden. Für den Computer scheint es dann immer so, als wären alle Blöcke defektfrei und nutzbar. Dieser Vorgang lässt sich jedoch per S.M.A.R.T. über den Parameter Reallocated Sector Count nachvollziehen.

Advanced Format

Festplattenmodelle verwenden seit 2010 zunehmend ein Sektorierungsschema mit größeren Sektoren mit fast ausschließlich 4096 Bytes („4K“). Die größeren Datenblöcke haben den Vorteil einer größeren Redundanz durch komplexere Datenwiederherstellung bei gleichzeitig geringerem Gesamtoverhead im Verhältnis zur Nutzdatenmenge. Um nach einer jahrzehntelangen, (fast) ausschließlichen Verwendung von Blöcken mit 512 Byte Kompatibilitätsprobleme zu vermeiden, emulieren die meisten Laufwerke an ihrer Schnittstelle eine Blockgröße von 512 Byte („512e“). Ein physischer Block von 4096 Byte wird als acht logische Blöcke von 512 Byte emuliert - die Laufwerksfirmware nimmt die zusätzlich notwendigen Schreib-/Leseoperationen dann selbstständig vor. Dadurch wird grundsätzlich eine Verwendung mit bestehenden Betriebssystemen und Treibern sichergestellt.

Die 512e-Emulation stellt sicher, dass Advanced-Format-Laufwerke mit vorhandenen Betriebssystemen kompatibel sind – es kann zu Leistungseinbußen kommen, wenn physische Blöcke nur teilweise beschrieben werden sollen (die Firmware muss dann den physischen Block lesen, verändern und wieder zurückschreiben). Solange die Organisationseinheiten (Cluster) des Dateisystems sich mit den physischen Sektoren genau decken, ist dies kein Problem, wohl aber, wenn die Strukturen zueinander versetzt sind. Bei aktuellen Linux-Versionen, bei Microsoft Windows ab Vista mit SP1 und Mac OS X ab Snow Leopard werden neue Partitionen so angelegt, wie es für Advanced-Format-Laufwerke sinnvoll ist; beim immer noch verbreiteten Windows XP nicht. Bei Windows XP lassen sich auf „4K“ ausgerichtete Partitionen mit verschiedenen Zusatztools anlegen; in der Regel werden solche Programme vom Laufwerkshersteller zur Verfügung gestellt.

Obwohl durch 48-Bit-LBA Festplatten bis zu 128 PiB unter Verwendung von 512-Byte-Sektoren angesprochen werden können, gibt es bei Verwendung des MBR als Partitionstabelle bereits bei Festplatten mit mehr als 2 TiB Einschränkungen. Auf Grund seiner nur 32 Bit großen Felder ist die maximal nutzbare Festplattengröße auf 2 TiB beschränkt (232 = 4.294.967.296 Sektoren bei einer Block-/Sektorgröße von 512 Byte). Für die uneingeschränkte Nutzung dieser Festplatten ist ein Betriebssystem nötig, welches die GPT unterstützt. Das Booten von Festplatten mit GPT unterliegt je nach Betriebssystem und BIOS bzw. Firmware weiteren Einschränkungen.

Bei zukünftigen Festplatten wird keine Emulation mehr verwendet („4K native“ / „4Kn“). Das Booten von solchen Datenträgern wird von Microsoft Windows ab Windows 8/Windows Server 2012[32] unterstützt.

Geschwindigkeit

Festplatten gehören mit zu den langsamsten Teilen der PC-Hardware. Deshalb ist das Thema Geschwindigkeit ein wesentlicher Faktor. Die wichtigsten technischen Parameter sind die kontinuierliche Übertragungsrate (sustained data rate) und die mittlere Zugriffszeit (data access time). Die Werte kann man den Datenblättern der Hersteller entnehmen.

Die kontinuierliche Übertragungsrate ist jene Datenmenge, die die Festplatte beim Lesen aufeinander folgender Sektoren im Mittel pro Sekunde überträgt. Die Werte beim Schreiben sind meist ähnlich und werden deshalb üblicherweise nicht angegeben.

Sowohl beim Schreiben als auch beim Lesen muss vor dem Zugriff auf einen bestimmten Block der Schreib-/Lesekopf der Platte zur gewünschten Spur bewegt und anschließend abgewartet werden, bis durch die Rotation der Platte dieser Block unter dem Kopf vorbeigeführt wird. Diese mechanisch bedingten Verzögerungen liegen Stand 2009 bei circa 6–20 ms, was nach Maßstäben anderer Computerhardware eine kleine Ewigkeit ist. Daraus ergibt sich die extrem hohe Latenzzeit von Festplatten im Vergleich zu RAM, die noch auf der Ebene der Softwareentwicklung und der Algorithmik berücksichtigt werden muss.

Die Zugriffszeit besteht aus mehreren Komponenten:

- der Spurwechselzeit (seek time),

- der Latenzzeit (latency) und

- die Kommando-Latenz (controller overhead).

Die Spurwechselzeit wird von der Stärke des Antriebs für den Schreib-/Lesekopf (Servo) bestimmt. Abhängig davon, welche Strecke der Kopf zurücklegen muss, ergeben sich unterschiedliche Zeiten. Angegeben wird normalerweise nur der Mittelwert beim Wechsel von einer zufälligen zu einer anderen zufälligen Spur (gewichtet nach der Zahl der Blöcke auf den Spuren). Seit circa 2003 bieten die meisten Desktop-Festplatten die Möglichkeit, per Konfiguration die Zugriffszeit zugunsten geringerer Geräuschentwicklung zu verlängern.

Die Latenzzeit ist eine unmittelbare Folge der Umdrehungsgeschwindigkeit. Im Mittel dauert es eine halbe Umdrehung, bis ein bestimmter Sektor unter dem Kopf vorbeikommt. Daraus ergibt sich der feste Zusammenhang:

Die Kommandolatenz ist die Zeit, die der Festplattencontroller damit verbringt, das Kommando zu interpretieren und die erforderlichen Aktionen zu koordinieren. Diese Zeit ist heutzutage vernachlässigbar.

Die Aussagekraft dieser technischen Parameter für die Systemgeschwindigkeit sind natürlich begrenzt. Deshalb wird im professionellen Bereich eine andere Kennzahl, nämlich Input/Output operations Per Second (IOPS) verwendet. Diese wird mittlerweile hauptsächlich von der Zugriffszeit dominiert. Aus der Definition wird klar, dass zwei halb so große Platten gleicher Geschwindigkeit dieselbe Datenmenge mit der doppelten IOPS-Zahl bereitstellen.

| Kategorie | Jahr | Modell | Größe in GB |

Drehzahl | Datenrate in MB/s |

Spurwechsel | Latenz | mittlere Zugriffszeit |

|---|---|---|---|---|---|---|---|---|

| Server | 1993 | IBM 0662 | 1 | 5.400 min−1 | 5 | 8,5 ms | 5,6 ms | 15,4 ms |

| Server | 2002 | Seagate Cheetah X15 36LP | 18 –36 |

15.000 min−1 | 52 –68 |

3,6 ms | 2,0 ms | 5,8 ms |

| Server | 2007 | Seagate Cheetah 15k.6 | 146 –450 |

15.000 min−1 | 112 –171 |

3,4 ms | 2,0 ms | 5,6 ms |

| Desktop | 1989 | Seagate ST296N | 0,080 | 3.600 min−1 | 0,5 | 28 ms | 8,3 ms | 40 ms |

| Desktop | 1993 | Seagate Marathon 235 | 0,064 –0,210 |

3.450 min−1 | 16 ms | 8,7 ms | 24 ms | |

| Desktop | 1998 | Seagate Medalist 2510–10240 | 2,5 –10 |

5.400 min−1 | 10,5 ms | 5,6 ms | 16,3 ms | |

| Desktop | 2000 | IBM Deskstar 75GXP | 20 –40 |

5.400 min−1 | 32 | 9,5 ms | 5,6 ms | 15,3 ms |

| Desktop | 2009 | Seagate Barracuda 7200.12 | 160 –1.000 |

7.200 min−1 | 125 | 8,5 ms | 4,2 ms | 12,9 ms |

| Notebook | 1998 | Hitachi DK238A | 3,2 –4,3 |

4.200 min−1 | 8,7 –13,5 |

12 ms | 7,1 ms | 19,3 ms |

| Notebook | 2008 | Seagate Momentus 5400.6 | 120 –500 |

5.400 min−1 | 39 –83 |

14 ms | 5,6 ms | 18 ms |

Die Entwicklung der Festplattenzugriffszeit kann mit der anderer PC-Komponenten wie CPU, RAM oder Grafikkarte nicht mehr Schritt halten, weshalb sie zum Flaschenhals geworden ist. Um eine hohe Leistung zu erreichen, muss eine Festplatte deshalb, soweit möglich, immer große Mengen von Daten in aufeinander folgenden Blöcken lesen oder schreiben, weil dabei der Schreib-Lesekopf nicht neu positioniert werden muss.

Das wird unter anderem dadurch erreicht, dass möglichst viele Operationen im RAM durchgeführt und auf der Platte die Positionierung der Daten auf die Zugriffsmuster abgestimmt werden. Dazu dient vor allem ein großer Cache im Arbeitsspeicher des Computers, der von allen modernen Betriebssystemen zur Verfügung gestellt wird. Zusätzlich hat die Festplattenelektronik einen Cache (Stand 2012 für Platten von 1 bis 2 TB zumeist 32 oder 64 MiB), der vor allem zur Entkopplung der Interface-Transferrate von der unveränderlichen Transferrate des Schreib-Lesekopfes dient.

Neben der Verwendung eines Caches gibt es weitere Software-Strategien zur Performance-Steigerung. Sie werden vor allem in Multitasking-Systemen wirksam, wo das Festplattensystem mit mehreren beziehungsweise vielen Lese- und Schreibanforderungen gleichzeitig konfrontiert wird. Es ist dann meist effizienter, diese Anforderungen in eine sinnvolle neue Reihenfolge zu bringen. Die Steuerung erfolgt durch einen Festplatten-Scheduler. Das einfachste Prinzip verfolgt dabei dieselbe Strategie wie eine Fahrstuhlsteuerung: Die Spuren werden zunächst in einer Richtung angefahren und die Anforderungen beispielsweise nach monoton steigenden Spurnummern abgearbeitet. Erst wenn diese alle abgearbeitet sind, kehrt die Bewegung um und arbeitet dann in Richtung monoton fallender Spurnummern usw.

Bis etwa 1990 besaßen Festplatten meist so wenig Cache (0,5 bis maximal 8 KiByte), dass sie keine komplette Spur (damals 8,5 KiByte oder 13 KiByte) zwischenspeichern konnten. Daher musste der Datenzugriff durch Interleaving gebremst beziehungsweise optimiert werden. Nicht notwendig war dies bei Platten mit hochwertigem SCSI- oder ESDI-Controller beziehungsweise bei den damals aufkommenden IDE-Platten.

Die seit circa 2008 verwendeten SSDs („Solid State Drive“) haben keine beweglichen Teile und weisen daher prinzipbedingt wesentlich kürzere Zugriffszeiten auf. Seit 2011 gibt es auch kombinierte Laufwerke, die - für den Computer transparent - einen Teil der Kapazität als SSD realisieren, die als Puffer der konventionellen Platte dient.

Partitionen

Aus Sicht des Betriebssystems können Festplatten durch Partitionierung in mehrere Bereiche unterteilt werden. Das sind keine echten Laufwerke, sondern sie werden nur vom Betriebssystem als solche dargestellt. Man kann sie sich als virtuelle Festplatten vorstellen, die durch den Festplattentreiber dem Betriebssystem gegenüber als getrennte Geräte dargestellt werden. Die Festplatte selbst „kennt“ diese Partitionen nicht, es ist eine Sache des übergeordneten Betriebssystems.

Jede Partition wird vom Betriebssystem gewöhnlich mit einem Dateisystem formatiert. Unter Umständen werden, je nach benutztem Dateisystem, mehrere Blöcke zu Clustern zusammengefasst, die dann die kleinste logische Einheit für Daten sind, die auf die Platte geschrieben werden. Das Dateisystem sorgt dafür, dass Daten in Form von Dateien auf die Platte abgelegt werden können. Ein Inhaltsverzeichnis im Dateisystem sorgt dafür, dass Dateien wiedergefunden werden und hierarchisch organisiert abgelegt werden können. Der Dateisystem-Treiber verwaltet die belegten, verfügbaren und defekten Cluster. Bekannte Beispiele für Dateisysteme sind FAT, NTFS (Windows), HFS Plus (Mac OS) und ext4 (Linux).

Geräuschvermeidung

Um die Lautstärke der Laufwerke beim Zugriff auf Daten zu verringern, unterstützen die meisten für den Desktop-Einsatz gedachten ATA- und SATA-Festplatten „Automatic Acoustic Management“ (AAM). Wird die Festplatte in einem leisen Modus betrieben, werden die Schreib/Leseköpfe weniger stark beschleunigt, so dass die Zugriffe leiser sind. Das Laufgeräusch des Plattenstapels sowie die Daten-Transferrate werden davon nicht verändert, jedoch verlängert sich die Zugriffszeit. Dem gleichen Zweck dienen als „Entkopplung“ oder „Entkoppler“ bezeichnete Aufhängungen mit elastischen Elementen, die eine Übertragung der Vibrationen der Festplatte auf Gehäusebauteile verhindern sollen.

Schnittstellen, Bussystem und Jumpering

Ursprünglich (bis 1990/91) befand sich das, was heute als Schnittstelle zur Festplatte verstanden wird, bei Consumer-Platten gar nicht auf der Festplatte. Dafür war ein Controller in Form einer ISA-Steckkarte notwendig. Dieser Controller sprach die Platte u. a. über ein ST506-Interface an (mit den Modulationsstandards MFM, RLL und ARLL). Die Kapazität der Platte war vom Controller abhängig, gleiches galt für die Datenzuverlässigkeit. Eine 20-MB-MFM-Platte konnte an einem RLL-Controller 30 MB speichern, aber ggf. mit einer höheren Fehlerrate.

Bedingt durch die Trennung von Controller und Medium musste letzteres vor dem Gebrauch low-level-formatiert werden (Soft-Sektorierung). Im Gegensatz zu diesen früheren Festplatten mit Schrittmotoren sind modernere Festplatten mit Linearmotoren ausgestattet, die eine (magnetische) Hart-Sektorierung während der Herstellung erforderlich machen und nicht mehr low-level-formatiert werden können.

Mit ESDI wurde ein Teil des Controllers auf das Laufwerk umgelagert, um Geschwindigkeit und Zuverlässigkeit zu steigern. Erst SCSI- und IDE-Platten machten Schluss mit dieser Tradition aus der Anfangszeit der plattenbasierten Magnetspeichertechnik. Sie setzen statt der früheren Controller Host-Bus-Adapter ein, die eine wesentlich universellere Schnittstelle zur Verfügung stellen. HBAs existieren als eigene Steckkarten als auch auf Hauptplatinen oder in Chipsätze integriert und werden häufig immer noch als „Controller“ bezeichnet.

Als Schnittstellen für interne Festplatten werden im Desktop-Bereich heute fast ausschließlich Serial-ATA-Schnittstellen eingesetzt. Bis vor einigen Jahren war hier noch parallele ATA- (oder IDE, EIDE)-Schnittstellen üblich. Allerdings ist die IDE-Schnittstelle in Spielkonsolen und Festplattenrekordern weiterhin weit verbreitet.

Bei Servern und Workstations hat sich neben SATA im Wesentlichen SAS und Fibre-Channel etabliert. Die Mainboards waren lange Zeit mit meist zwei ATA-Schnittstellen versehen, inzwischen wurden diese annähernd vollständig durch (bis zu 10) SATA-Schnittstellen ersetzt.

Ein prinzipielles Problem bei parallelen Übertragungen ist, dass es mit zunehmender Geschwindigkeit immer schwieriger wird, unterschiedliche Laufzeiten der einzelnen Bits durch das Kabel sowie Übersprechen zu beherrschen. Daher stießen die parallelen Schnittstellen mehr und mehr an ihre Grenzen. Serielle Leitungen, insbesondere in Verbindung mit differentiellen Leitungspaaren erlauben inzwischen deutlich höhere Übertragungsraten.

ATA (IDE)

Bei einer ATA-Festplatte wird durch Jumper festgelegt, ob sie das Laufwerk mit Adresse 0 oder 1 der ATA-Schnittstelle ist (Device 0 beziehungsweise 1, oft mit Master beziehungsweise Slave bezeichnet). Manche Modelle erlauben eine Beschränkung der an das Betriebssystem beziehungsweise BIOS gemeldeten Kapazität des Laufwerks, wodurch die Festplatte im Falle von Inkompatibilitäten dennoch (unter Verschenkung des nicht gemeldeten Plattenplatzes) in Betrieb genommen werden kann.

Durch die Festlegung der ATA-Bus-Adresse können zwei Festplatten an einer ATA-Schnittstelle des Mainboards angeschlossen werden. Die meisten Mainboards haben zwei ATA-Schnittstellen, genannt primary ATA und secondary ATA, also „erste“ und „zweite ATA-Schnittstelle“. Daher können insgesamt bis zu vier Festplatten an beide ATA-Schnittstellen der Hauptplatine angeschlossen werden. Ältere BIOS von Hauptplatinen erlauben es nur, den Computer von der ersten ATA-Schnittstelle zu starten, und auch nur, wenn die Festplatte als Master gejumpert ist.

Die ATA-Schnittstellen werden jedoch nicht nur von Festplatten, sondern auch von CD-ROM- und DVD-Laufwerken genutzt. Somit ist (ohne Zusatzkarte) die Gesamtzahl von Festplatten plus ladbaren Laufwerken (CD-ROM, DVD) auf vier begrenzt (Diskettenlaufwerke haben eine andere Schnittstelle). CompactFlash-Karten können per Adapter angeschlossen und wie eine Festplatte verwendet werden.

Bei Erweiterungen sind einige Dinge zu beachten:

- Das erste Laufwerk ist als „Master“ zu jumpern – in der Regel die Voreinstellung von Laufwerken; erst ein eventuell zweites Laufwerk an einem Kabel wird auf „Slave“ gejumpert. Einige Laufwerke haben noch die dritte Option „Single Drive“. Diese wird dann benutzt, wenn das Laufwerk alleine am Kabel hängt; kommt ein „Slave“-Laufwerk dazu, muss man das erste als „Master“ jumpern. Diese Option heißt dann zur Erläuterung oftmals „Master with Slave present“.

- Wo Master oder Slave sitzen (am Ende des Kabels oder „mittendrin“), spielt keine Rolle (außer, beide Laufwerke sind auf Cable Select gejumpert). „Slave allein“ funktioniert zwar meistens, gilt aber nicht als sauber konfiguriert und ist oft störanfällig. Ausnahme: Bei den neueren 80-poligen Kabeln sollte der Slave in der Mitte angeschlossen werden; die Stecker sind dementsprechend beschriftet.

Die ideale Verteilung der Laufwerke auf die einzelnen Anschlüsse ist disputabel. Zu beachten ist, dass sich traditionell zwei Geräte am selben Kabel die Geschwindigkeit teilen und dass das langsamere Gerät den Bus länger belegt und somit das schnellere bremsen kann. Bei der gängigen Konfiguration mit einer Festplatte und einem CD/DVD-Laufwerk ist es daher von Vorteil, jedes dieser beiden Geräte mit einem eigenen Kabel zu einer Schnittstelle auf der Hauptplatine zu verwenden. Neben den Jumpern existiert ein automatischer Modus für die Bestimmung der Adressen („Cable-Select“), der jedoch geeignete Anschlusskabel erfordert, die früher wenig verbreitet waren, aber seit ATA-5 (80-polige Kabel) Standard sind.

ESDI

SCSI

Die Adresse von SCSI-Festplatten kann nicht wie IDE-Festplatten nur zwischen zwei, sondern je nach verwendetem Controller zwischen 7 bzw. 15 Adressen ausgewählt werden. Dafür befinden sich an älteren SCSI-Laufwerken drei bzw. vier Jumper zur Festlegung der Adresse – SCSI-ID-Nummer genannt –, die es erlauben, bis 7 bzw. 15 Geräte pro SCSI-Bus einzeln zu adressieren. Die Anzahl der maximal möglichen Geräte ergibt sich aus der Anzahl der ID-Bits (drei bei SCSI bzw. vier bei Wide-SCSI) unter Berücksichtigung der vom Controller selbst belegten Adresse #0. Neben Jumpern fand man selten die Adresseinstellung auch durch einen kleinen Drehschalter. Bei modernen Systemen werden die IDs automatisch vergeben (nach der Reihenfolge am Kabel), und die Jumper sind nur noch relevant, wenn diese Vergabe beeinflusst werden soll.

Dazu kommen noch andere Jumper wie der (optionale) Schreibschutzjumper, der es erlaubt, eine Festplatte gegen Beschreiben zu sperren. Weiterhin können je nach Modell Einschaltverzögerungen oder das Startverhalten beeinflusst werden.

SATA

Schwarz: Masse,

Orange: 3,3 V,

Rot: 5 V,

Gelb: 12 V

Seit 2002 werden Festplatten mit Serial ATA (S-ATA oder SATA)-Schnittstelle angeboten. Die Vorteile gegenüber ATA sind der höhere mögliche Datendurchsatz und die vereinfachte Kabelführung. Erweiterte Versionen von SATA verfügen über weitere, vor allem für professionelle Anwendungen relevante, Funktionen, wie etwa die Fähigkeit zum Austausch von Datenträgern im laufenden Betrieb (Hot-Plug). Inzwischen hat sich SATA praktisch durchgesetzt, die neuesten Festplatten werden nicht mehr als IDE-Versionen angeboten, seit die bei IDE theoretisch möglichen Transferraten nahezu erreicht sind.

Im Jahr 2005 wurden erste Festplatten mit Serial Attached SCSI (SAS) als potentieller Nachfolger von SCSI für den Server- und Storagebereich vorgestellt. Dieser Standard ist teilweise zu SATA abwärtskompatibel.

Serial Attached SCSI (SAS)

Die SAS-Technik basiert auf der etablierten SCSI-Technik, sendet die Daten jedoch seriell und verbindet die Geräte nicht über einen gemeinsamen Bus sondern einzeln über dedizierte Ports (oder Port Multiplier). Neben der höheren Geschwindigkeit im Vergleich zu herkömmlicher SCSI-Technik können theoretisch über 16.000 Geräte in einem Verbund angesprochen werden. Ein weiterer Vorteil ist die maximale Kabellänge von 10 Metern. Die Steckverbindungen von SATA sind zu SAS kompatibel, ebenso SATA-Festplatten; SAS-Festplatten benötigen jedoch einen SAS-Controller.

Fibre-Channel-Interface

Die Kommunikation via Fibre-Channel-Interface ist noch leistungsfähiger und ursprünglich vor allem für die Verwendung in Speichersubsystemen entwickelt. Die Festplatten werden, wie bei USB, nicht direkt angesprochen, sondern über einen FC-Controller, FC-HUBs oder FC-Switches.

Queuing im SCSI-, SATA oder SAS-Datentransfer

Vor allem bei SCSI-Platten und bei neueren SATA-Festplatten werden sogenannte Queues (Warteschlangen) eingesetzt. Das sind Software-Verfahren als Teil der Firmware, die die Daten zwischen dem Anfordern von Computerseite und physikalischem Zugriff auf die Speicherscheibe verwalten und ggf. zwischenspeichern. Beim Queuing reihen sie die Anfragen an den Datenträger in eine Liste und sortieren sie entsprechend der physikalischen Position auf der Scheibe und der aktuellen Position der Schreibköpfe, um so möglichst viele Daten mit möglichst wenigen Umdrehungen und Kopfpositionierungen zu lesen. Der festplatteneigene Cache spielt hier eine große Rolle, da die Queues in diesem abgelegt werden (siehe auch: Tagged Command Queuing, Native Command Queuing).

Vorläufer der seriellen High-Speed-Schnittstellen

Die ersten verbreiteten seriellen Schnittstellen für Festplatten waren SSA (Serial Storage Architecture, von IBM entwickelt) und Fibre Channel in der Variante FC-AL (Fibre Channel-Arbitrated Loop). SSA-Festplatten werden heute praktisch nicht mehr hergestellt, aber Fibre-Channel-Festplatten werden weiterhin für den Einsatz in großen Speichersystemen gebaut. Fibre Channel bezeichnet dabei das verwendete Protokoll, nicht das Übertragungsmedium. Deshalb haben diese Festplatten trotz ihres Namens keine optische, sondern eine elektrische Schnittstelle.

Externe Festplatten

Externe Festplatten gibt es als physische Massenspeicher (Block-Geräte) als USB-, Firewire- oder eSATA-Platten oder als logische Massenspeicher (NAS) mit Anschluss über Ethernet- und/oder WLAN. Im ersteren Falle ist die Festplatte aus Sicht des Betriebssystems ein spezielles Laufwerk; in zweiten Falle ist das gesamte NAS ein spezieller über ein Netzwerk angebundener Computer.

Für den Anschluss von externen Festplatten werden universelle Schnittstellen wie FireWire oder USB, immer öfter auch eSATA, verwendet. Zwischen der Festplatte und der Schnittstelle befindet sich hierzu eine Bridge, die an einer Seite einen PATA- oder SATA-Anschluss und an der anderen Seite einen USB-, Firewire-, eSATA-Anschluss oder mehrere dieser Anschlüsse hat.

Bei derartigen externen Festplatten sind teilweise zwei Festplatten in einem Gehäuse verbaut, die nach außen jedoch nur als ein Laufwerk auftreten (RAID-System). Sehr ähnlich arbeiten NAS-Systeme, bei denen dann ein Netzwerkanschluss vorhanden ist. Hier ist die Kapazität praktisch unbegrenzt erweiterbar.

Datensicherheit

Besonders für Behörden und Unternehmen, die Festplatten zur Datenspeicherung oder zum Transport einsetzen, sind Datenschutz und Datensicherheit äußerst sensible Themen. Vor allem im Bereich der externen Festplatten, die als mobile Datenspeicher eingesetzt werden, müssen sich Behörden und Unternehmen auf absolute Sicherheit verlassen können. Gelangen sensible Daten in unbefugte Hände, entsteht meist ein irreparabler Schaden. Um dies zu verhindern und höchste Datensicherheit für den mobilen Datentransport zu gewährleisten, müssen folgende Hauptkriterien beachtet werden:

- Verschlüsselung,

- Zugriffskontrolle und die

- Verwaltung des kryptographischen Schlüssels.

Verschlüsselung

Es kann eine einfache XOR-Verknüpfung oder eine Verschlüsselung nach AES (Advanced Encryption Standard) mit unterschiedlichen Schlüssellängen und Blockmodi verwendet werden. Die Wahl einer passenden Verschlüsselung entscheidet über die Grundlage zum Erreichen eines höchsten Maßes an Datensicherheit. Für höchste Anforderungen an Datensicherheit empfiehlt das Bundesamt für Sicherheit in der Informationstechnik, die AES-Verschlüsselung mit einer Schlüssellänge von 256 Bit im CBC-Modus zu verwenden.

Zugriffskontrolle

Die Zugriffskontrolle kann von einem einfachen Passwort bis hin zu komplexen mehrstufigen Authentifizierungsmethoden reichen. Entscheidet man sich für eine komplexe Zugriffsmethode mit Zwei-Faktor-Authentifizierung (z. B. Smartcard und PIN) kann dies die Sicherheit der Daten erhöhen.

Verwaltung des kryptographischen Schlüssels

Im Allgemeinen beinhaltet die Verwaltung des Schlüssels Informationen über die Erstellung, Speicherung und Möglichkeiten zur Zerstörung.

Es muss sichergestellt sein, dass sich der Schlüssel an einem sicheren Ort befindet und für Unbefugte unzugänglich bleibt. Auf die externen Speicher bezogen, ist es wichtig zu wissen, wie der kryptographische Schlüssel hergestellt wurde und ob bei der Herstellung oder auf dem Weg zum Nutzer eine Kopie des Schlüssels angefertigt werden konnte. Es ist wichtig zu wissen, wie sicher und wo der Schlüssel für die Verwendung abgelegt ist. Typische Speicherorte des Kryptoschlüssels sind: auf der Festplatte, im Sicherheitscontroller oder außerhalb des Speichermediums wie zum Beispiel auf einer Smartcard.

Außerdem ist es wichtig zu wissen, wie der Kryptoschlüssel in einer extremen Situation durch den Benutzer schnell zerstört werden kann, damit Unbefugte mittels Zwang nicht an die sensiblen Daten gelangen können.

Es ist zu beachten, dass immer alle drei Sicherheitskriterien berücksichtigt werden müssen. Hat eines von diesen Kriterien eine Sicherheitslücke, so wird dadurch die ganze Sicherheitskette gefährdet.

Ausfallursachen und Lebensdauer

Zu den typischen Ausfallursachen gehören:

- Die Anfälligkeit von Festplatten ist besonders bei den neuen, sehr schnell drehenden Systemen vorwiegend auf thermische Probleme zurückzuführen.

- Beim mechanischen Aufsetzen des Schreib-Lesekopfes kann die Festplatte beschädigt werden (Head-Crash). Der Kopf schwebt im Betrieb auf einem Luftpolster über der Platte und wird nur durch dieses Polster daran gehindert aufzusetzen. Im laufenden Betrieb sollte die Festplatte daher möglichst nicht bewegt werden und keinen Erschütterungen ausgesetzt sein.

- Äußere Magnetfelder können die Sektorierung der Festplatte beeinträchtigen und sogar zerstören.[33]

- Fehler in der Steuerelektronik oder Verschleiß der Mechanik führen zu Ausfällen.

- Umgekehrt kann auch längerer Stillstand dazu führen, dass die Mechanik in Schmierstoffen stecken bleibt und die Platte gar nicht erst anläuft („sticky disk“).

Die durchschnittliche Zahl an Betriebsstunden, bevor eine Festplatte ausfällt, wird bei irreparablen Platten als MTTF (Mean Time To Failure) bezeichnet. Bei Festplatten, die repariert werden können, wird ein MTBF-Wert (Mean Time Between Failures) angegeben. Alle Angaben zur Haltbarkeit sind ausschließlich statistische Werte. Die Lebensdauer einer Festplatte kann daher nicht im Einzelfall vorhergesagt werden, denn sie hängt von vielen Faktoren ab:

- Vibrationen und Stöße: Starke Erschütterungen können zu einem vorzeitigen (Lager-)Verschleiß führen und sollten daher vermieden werden.

- Unterschiede zwischen verschiedenen Modellreihen eines Herstellers: Abhängig vom jeweiligen Modell lassen sich bestimmte Baureihen ausmachen, die als besonders zuverlässig oder fehleranfällig gelten. Um statistisch genau Angaben zu der Zuverlässigkeit machen zu können, sind eine große Anzahl von baugleichen Platten notwendig, die unter ähnlichen Bedingungen betrieben werden. Systemadministratoren, die viele Systeme betreuen, können so im Laufe der Jahre durchaus einige Erfahrungen sammeln, welche Festplatten eher zu auffälligem Verhalten und damit vorzeitigem Ausfall neigen.

- Anzahl der Zugriffe (Lesekopfbewegungen): Durch häufige Zugriffe verschleißt die Mechanik schneller, als wenn die Platte nicht genutzt wird und sich nur der Plattenstapel dreht.

- Wenn die Festplatte über der vom Hersteller genannten Betriebstemperatur, meist 40–55 °C, betrieben wird, leidet die Lebensdauer. Nach einer Studie des Unternehmens Google Inc. (welches interne Festplattenausfälle analysierte) gibt es am oberen Ende des zulässigen Bereiches keine vermehrten Ausfälle.[34]

Allgemein sind schnelldrehende Server-Festplatten für eine höhere MTTF ausgelegt als typische Desktop-Festplatten, so dass sie theoretisch eine höhere Lebensdauer erwarten lassen. Dauerbetrieb und häufige Zugriffe können jedoch dazu führen, dass sich das relativiert und die Festplatten nach wenigen Jahren ausgetauscht werden müssen.

Notebook-Festplatten werden durch die häufigen Transporte besonders beansprucht und sind dementsprechend trotz robusterer Bauart mit einer kleineren MTTF als Desktop-Festplatten spezifiziert.

Eine genaue Haltbarkeit der gespeicherten Daten wird von den Herstellern nicht angegeben. Lediglich magneto-optische Verfahren erreichen eine Persistenz von 50 Jahren und mehr.

Vorbeugende Maßnahmen

Als vorbeugende Maßnahmen gegen Datenverlust werden daher häufig folgende Maßnahmen ergriffen:

- Von wichtigen Daten sollte immer eine Sicherungskopie (Backup) auf einem anderen Datenträger (beachte den Hinweis zum Ausfall oben unter Partitionierung) existieren.

- Systeme, die zwingend hochverfügbar sein müssen und bei denen ein Festplattenfehler keine Betriebsunterbrechung und Datenverlust verursachen darf, verfügen meistens über RAID. Eine Konfiguration ist zum Beispiel das Mirrorset (RAID 1), bei dem die Daten auf zwei Festplatten gespiegelt werden und sich somit die Ausfallsicherheit erhöht. Effizientere Konfigurationen sind RAID 5 und höher. Ein Stripeset (RAID 0) aus zwei Festplatten erhöht zwar die Geschwindigkeit, jedoch steigt das Ausfallrisiko. RAID 0 ist deshalb keine Maßnahme, um Datenverlust zu verhindern oder die Verfügbarkeit des Systems zu erhöhen.

- ATA-Festplatten verfügen seit circa Ende der 1990er Jahre über S.M.A.R.T., eine interne Überwachung der Festplatte auf Zuverlässigkeit. Der Status kann von außen abgefragt werden. Ein Nachteil ist, dass S.M.A.R.T. kein Standard ist. Jeder Hersteller definiert seine Fehlertoleranz selbst, d. h. S.M.A.R.T. ist nur als allgemeines Richtmittel anzusehen. Außerdem gibt es Festplatten, deren S.M.A.R.T.-Funktion selbst dann noch nicht vor Problemen warnt, wenn diese sich bereits im Betrieb durch nicht mehr lesbare Blöcke bemerkbar gemacht haben.

- Die meisten Festplatten können in beliebiger Lage montiert werden, im Zweifelsfall sollte die Spezifikation des Herstellers beachtet werden. Des Weiteren ist die Festplatte fest zu verschrauben, um Eigenschwingung zu unterbinden.

- Während des Einbaus sollten Maßnahmen zum Schutz vor ESD getroffen werden.

Datenschutz

Unabhängig vom verwendeten Speichermedium (in diesem Fall eine Festplatte) wird beim Löschen einer Datei lediglich im Dateisystem vermerkt, dass der entsprechende Datenbereich nun frei ist. Die Daten selbst verbleiben jedoch physisch auf der Festplatte, bis der entsprechende Bereich mit neuen Daten überschrieben wird. Mit Datenrettungsprogrammen können gelöschte Daten daher oft zumindest zum Teil wiederhergestellt werden. Das wird häufig in der Beweissicherung zum Beispiel bei den Ermittlungsbehörden (Polizei usw.) eingesetzt.

Beim Partitionieren oder gewöhnlichen Formatieren wird der Datenbereich nicht überschrieben, sondern lediglich die Partitionstabelle oder die Beschreibungsstruktur des Dateisystems.

Um ein sicheres Löschen von sensiblen Daten zu garantieren, bieten verschiedene Hersteller Software an, sogenannte Eraser, die beim Löschen den Datenbereich mehrfach überschreibt. Meistens kann aber auf eine (fast) beliebige und kostenlose Unix-Distribution zurückgegriffen werden, wie zum Beispiel Knoppix, die praktischerweise direkt von CD gestartet werden können. Außerdem gibt es für diesen Zweck neben universellen Programmen wie dd und badblocks speziell für das Löschen verschiedene Open-Source-Programme, beispielsweise Darik’s Boot and Nuke (DBAN). In Apples Mac OS X sind entsprechende Funktionen („Papierkorb sicher löschen“ und „Volume mit Nullen überschreiben“) bereits enthalten. Wurde die Datei bereits gelöscht, ohne die Daten zu überschreiben, kann der komplette freie Speicher der Festplatte überschrieben werden, dabei wird der Speicher mehrmals überschrieben, um zu verhindern, dass sich die Daten mit Spezialhardware z. B. von Datenwiederherstellungsunternehmen oder Behörden wiederherstellen lassen. Die Gutmann-Methode wurde 1996 vorgestellt, um ein sicheres Löschen der Daten zu garantieren. Seitdem ist die Kapazität allerdings so stark angestiegen, dass es auch bei einmaligem Überschreiben nachweisbar unmöglich ist, mit heutiger Technik Daten wieder herzustellen.[35]

Alternativ bietet sich bei der Verschrottung des Computers die mechanische Vernichtung der veralteten Festplatte beziehungsweise der Scheiben an. Deshalb werden in manchen Unternehmen beim Umstieg auf eine neue Computergeneration alle Festplatten in einem Schredder in kleine Teile zermahlen und die Daten so vernichtet.

Verschiedene Festplatten bieten die Möglichkeit an, den kompletten Festplatteninhalt per Passwort direkt auf Hardwareebene zu schützen. Da diese im Grunde nützliche Eigenschaft jedoch kaum bekannt ist und die meisten BIOS die Funktion zum Setzen des Passworts nicht selbsttätig ausschalten, besteht rein theoretisch für Schadprogramme wie Viren die Chance, dem Benutzer durch Setzen dieses Passworts auf einen unbekannten Wert massiv zu schaden. Danach bestünde keine Möglichkeit mehr, noch auf Inhalte der Festplatte zuzugreifen. Für weitere Informationen bzgl. ATA-Festplatten siehe ATA/ATAPI.

Langzeitarchivierung

Geschichte

Vorläufer der Festplatte war die Magnettrommel ab 1932. Außerhalb von Universitäten und Forschungseinrichtungen kam dieser Speicher ab 1958 als „Hauptspeicher“ mit 8192 Worten à 32 Bit in der Zuse Z22 zum Einsatz. Die erste kommerziell erhältliche Festplatte, die IBM 350, wurde von IBM 1956 als Teil des IBM 305 RAMAC-Rechners („Random Access Method of Accounting and Control“) angekündigt.

Chronologische Übersicht

- September 1956:[36] IBM stellt das erste magnetische Festplattenlaufwerk mit der Bezeichnung „IBM 350“ vor (5 MB, 24 Zoll, 600 ms Zugriffszeit, 1.200 min−1, 500 kg, 10 kW). Die Schreib-/Leseköpfe wurden elektronisch-pneumatisch gesteuert, weshalb die schrankgroße Einheit einen Druckluft-Kompressor enthielt.[37] Das Laufwerk wurde nicht verkauft, sondern für 650 US-Dollar pro Monat vermietet.[38] Ein Exemplar der IBM350 befindet sich im Museum des IBM-Clubs in Sindelfingen. An der Entwicklung wesentlich beteiligt am Forschungszentrum in San José (Leitung Reynold B. Johnson) waren Louis Stevens, William A. Goddard, John Lynott.

- 1973: IBM startet das „Winchester“-Projekt, das sich damit befasste, einen rotierenden Speicher mit einem fest montierten Medium zu entwickeln (IBM 3340, 30 MB Speicherkapazität, 30 ms Zugriffszeit). Beim Starten und Stoppen des Mediums sollten die Köpfe auf dem Medium aufliegen, was einen Lademechanismus überflüssig machte. Namensgeber war die Stadt Winchester in Südengland, in deren IBM-Werk das Laufwerk entwickelt wurde. Diese Technik setzte sich in den folgenden Jahren durch. Bis in die 1990er Jahre war deshalb für Festplatten die Bezeichnung Winchester-Laufwerk gebräuchlich.

- 1979: Vorstellung der ersten 8″-Winchester-Laufwerke. Diese waren jedoch sehr schwer und teuer; trotzdem stieg der Absatz kontinuierlich.

- 1980: Verkauf der ersten 5,25″-Winchester-Laufwerke durch die Firma Seagate Technology („ST506“, 6 MB, 3.600 min−1, Verkaufspreis circa 1000 $). Diese Modellbezeichnung (ST506) wurde über viele Jahre hinaus der Name für diese neue angewendete Schnittstelle, welche alle anderen Firmen als neuen Standard im PC-Bereich übernommen hatten. Zur gleichen Zeit kam neben den bereits bestehenden Apple-Microcomputern der erste PC von IBM auf den Markt, dadurch stieg die Nachfrage nach diesen – im Vergleich zu den Winchester-Laufwerken kompakten – Festplatten rasant an.

- 1986: Spezifikation von SCSI, eines der ersten standardisierten Protokolle für eine Festplattenschnittstelle.

- 1989: Standardisierung von IDE, auch bekannt als AT-Bus.

- 1991: erste 2,5-Zoll-Festplatte mit 100 MB Speicherkapazität[39]

- 1997: Erster Einsatz des Riesen-Magnetowiderstands (englisch Giant Magnetoresistive Effect (GMR)) bei Festplatten, dadurch konnte die Speicherkapazität erheblich gesteigert werden. Eine der ersten Festplatten mit GMR-Leseköpfen brachte IBM im November 1997 heraus (IBM Deskstar 16GP DTTA-351680, 3,5″, 16,8 GB, 0,93 kg, 9,5 ms, 5.400 min−1).

- 2004: Erste SATA-Festplatten mit Native Command Queuing von Seagate.

- 2005: Prototyp einer 2,5-Zoll-Hybrid-Festplatte (Kurzbezeichnung H-HDD), die aus einem magnetisch-mechanischen Teil und einem zusätzlichen NAND-Flash-Speicher aufgebaut ist, der als Puffer für die Daten dient. Erst wenn der Puffer voll ist, werden die Daten aus dem Puffer auf das Magnetmedium der Festplatte geschrieben.

- 2006: Erste 2,5-Zoll-Notebook-Festplatte (Momentus 5400.3, 2,5″, 160 GB, 0,1 kg, 5,6 ms, 5.400 min−1, 2 Watt) von Seagate mit senkrechter Aufzeichnungstechnik (Perpendicular Recording). 3,5-Zoll-Festplatten erreichen mit derselben Aufzeichnungstechnik im April eine Kapazität von 750 GB.

- 2007: Die erste Terabyte-Festplatte von Hitachi.[40] (3,5″, 1 TB, 0,7 kg, 8,5 ms, 7.200 min−1, 11 Watt)

- 2009: Erste 2-TB-Festplatte von Western Digital (Caviar Green, 5400 min−1)

- 2010: Erste 3-TB-Festplatte von Western Digital (Caviar Green). Systeme ohne UEFI können diese Festplatte nicht ansprechen. WD liefert eine spezielle Controllerkarte mit, mit welcher die 2,5 TB und 3 TB großen Festplatten von PCs mit älterem Bios als sekundäre Platten voll angesprochen werden können. Seagate umgeht dieses Problem durch den Einsatz größerer Sektoren (Advanced Format).

- 2011: Überschwemmungen zerstörten etliche Fabriken in Thailand und machten die weltweiten Abhängigkeiten u. a. der Festplattenindustrie deutlich: Lieferausfälle führten zur Knappheit von Bauelementen und die Preise für Festplatten auf dem Endverbrauchermarkt in Deutschland schnellten auf ein Mehrfaches in die Höhe. Hitachi GST beziehungsweise Western Digital liefert in kleinen Stückzahlen die ersten 4-TB-3,5"-Festplatten Deskstar 5K4000 (intern) beziehungsweise Touro Desk (externe USB-Variante) mit 1 TB pro Platter aus.[41] Auch Samsung kündigt entsprechende Modelle mit einer Kapazität von 1 TB pro Platter an. Erste Modelle sollen die Spinpoint F6 mit 2 TB und 4 TB sein.

Hersteller

Im zweiten Quartal 2013 wurden weltweit 133 Millionen Festplattenlaufwerke mit einer Gesamtkapazität von 108 Exabyte (108 Millionen Terabyte) abgesetzt.[42]

| Name | Marktanteil 2013 Q2[42] |

|---|---|

| Western Digital | 45 % |

| Toshiba | 15 % |

| Seagate | 40 % |

Ehemalige Hersteller:

- Conner Peripherals wurde 1996 von Seagate übernommen.

- Quantum wurde 2000 von Maxtor übernommen.

- IBMs Festplattensparte wurde 2002 von Hitachi übernommen.

- Maxtor wurde 2006 von Seagate übernommen.

- Fujitsus Festplattensparte wurde 2010 von Toshiba übernommen.[43]

- ExcelStor

- Samsungs Festplatten-Sparte wurde im Oktober 2011 von Seagate übernommen.[44]

- HGST (Hitachi) wurde im März 2012 von Western Digital übernommen, [45] wobei WD auf Druck der Kartellbehörden einen Teil der 3,5"-Produktionseinrichtungen an Toshiba abgeben musste.[46]

Siehe auch

Weblinks

- Lexikon der Festplatten

- tecchannel.de: „50 Jahre Festplatte“, 13. September 2006

- HDD from inside: Main parts – Fotoserie mit Beschreibung anhand eines 3,5″ SATA drives. (englisch)

- Festplattenschnittstellen im Überblick

- A brief History of Areal Density

Einzelnachweise

- ↑ Fritz-Haber-Institut: Museum des Gemeinsamen Netzwerkzentrum (GNZ), Berlin. Fhi-berlin.mpg.de. Abgerufen am 11. August 2010.

- ↑ Hitachi Introduces 1-Terabyte Hard Drive | PCWorld

- ↑ 2,5 Zoll vs. 3,5 Zoll: Festplatten-Modelle : Paradigmenwechsel: 2,5-Zoll-Festplatten im Unternehmensbereich

- ↑ Datenblatt ST1181677 (PDF; 1,5 MB) Abgerufen am 28. Dezember 2010.

- ↑ Josh Shaman: WD Announces 5mm WD Blue HDDs and WD Black SSHDs auf http://www.storagereview.com/ vom 23. April 2013, abgerufen am 25. April 2013

- ↑ 2,5″-Highend-Festplatte mit Serial ATA, 300 GByte und Kühlkörper, heise.de, 21. April 2008

- ↑ IBM Archives: IBM 1301 disk storage unit. 03.ibm.com. Abgerufen am 11. August 2010.

- ↑ HP Kittyhawk Hard Drive bei homebrewcpu.com, abgerufen am 10. August 2013.

- ↑ heise online – Billige IDE-Platten bis 12 GByte

- ↑ Festplatte mit 47 GByte, 14. November 1997

- ↑ Speicherrekord: 320-GByte-Festplatte von Maxtor (Update), heise.de, 9. September 2002

- ↑ heise online – Festplatten speichern ein halbes Terabyte Daten

- ↑ heise online – Notebook-Festplatte mit 160 GByte und Perpendicular Recording

- ↑ Hitachi kündigt Festplatte mit 1 TByte Kapazität an – PCtipp.ch – News

- ↑ Seagate: Erste Festplatte mit 1,5 TByte. Golem.de. Abgerufen am 11. August 2010.

- ↑ 2,5-Zoll Festplatte Samsung Spinpoint M6 HM500LI. Channelpartner.de. 27. Juni 2008. Abgerufen am 11. August 2010.

- ↑ Toshiba: Schnelle Festplatte im 1,8-Zoll-Format. Golem.de. 25. September 2008. Abgerufen am 11. August 2010.

- ↑ Panasonic KX-TG8521GN. Alternate.de. Abgerufen am 11. August 2010.

- ↑ 2-TB-HDD von Western Digital offiziell vorgestellt. Computerbase.de. 27. Januar 2009. Abgerufen am 11. August 2010.

- ↑ WD Scorpio Blue 1 TB SATA Hard Drives (WD10TPVT). Wdc.com. Abgerufen am 11. August 2010.

- ↑ http://www.hitachigst.com/portal/site/en/products/deskstar/7K2000/ (Link nicht abrufbar)

- ↑ Seagate trumpft mit externer 3TB-Festplatte für 250 Dollar auf. 29. Juni 2010. Abgerufen am 18. Oktober 2010.

- ↑ AnandTech - Seagate Ships World's First 4 TB External HDD

- ↑ 2,5-Zoll-SATA-Platte mit 2 Terabyte - aber nicht für Notebooks

- ↑ Erste 1,5 TB, 2,5 Zoll Festplatte mit Standardnotebookgröße 9,5 mm

- ↑ Erste Festplatte mit 2 TByte und 9,5 Millimetern Bauhöhe

- ↑ Erste 6-Terabyte-Festplatte kommt mit Helium-Füllung

- ↑ Platter Substrate Materials

- ↑ Hard Drive Data Recovery – A Basic Understanding of Platter Substrate Material

- ↑ Joyce Y. Wong: Perpendicular patterned media for high density magnetic storage. (englisch). California Institute of Technology, 2000 (Zugriff am 5. Januar 2011).

- ↑ Kap. 11.4.2 „Emergency unload“, Hard Disk Drive Specification Hitachi Travelstar 80GN (PDF; 986 kB)

- ↑ Microsoft-Richtlinie für große Festplatten mit 4K-Sektoren in Windows, Microsoft-Knowledge-Base-Eintrag KB2510009

- ↑ Löschzug – Notebooks und Scheckkarten in Gefahr.. C’t magazin 8/98. Abgerufen am 3. März 2011.

- ↑ Failure Trends in a Large Disk Drive Population (PDF; 247 kB) labs.google.com. Abgerufen am 11. August 2010.

- ↑ heise online: Sicheres Löschen: Einmal überschreiben genügt

- ↑ Je nach Quelle 4. September 1956, 13. September 1956 oder 14. September 1956

- ↑ IBM Archives: IBM 350 disk storage unit

- ↑ Emerson W. Pugh: RAMAC in Historical Perspective. Magnetic Disk Heritage Center, 26. Mai 2005, S. 7; abgerufen am 21. Juni 2012 (pdf; 59 kB, englisch).

- ↑ Computer Facts and History

- ↑ Produktseite der Deskstar 7K1000. Hitachigst.com. Abgerufen am 9. September 2010.

- ↑ 4-Terabyte-Festplatten von Hitachi. Heise.de. 13. Dezember 2011. Abgerufen am 13. Dezember 2011.

- 1 2 http://www.storagenewsletter.com/news/marketreport/trendfocus-hdd-2q13

- ↑ Fujitsu-Festplattensparte geht in Toshiba Storage Device Corporation (TSDC) auf. Heise.de. 3. Dezember 2009. Abgerufen am 11. August 2010.

- ↑ Seagate Completes Acquisition of Samsung’s Hard Disk Drive Business. seagate.com. 19. Dezember 2011. Abgerufen am 9. November 2013.

- ↑ High Prices Generate Record Revenue for HDD Market in Q1. iSuppli. 12. Juni 2012. Abgerufen am 17. Januar 2014.

- ↑ WD Reaches Agreement with Toshiba Corporation to Divest Certain 3.5-Inch HDD Assets. WDC.com. 28. Februar 2012. Abgerufen am 17. Januar 2014.

Vorlage:Link FA Vorlage:Link FA